Llama 3加持,用户实测Meta AI还是弱爆了!小扎弯道超车的策略竟是「免费+不限量」?

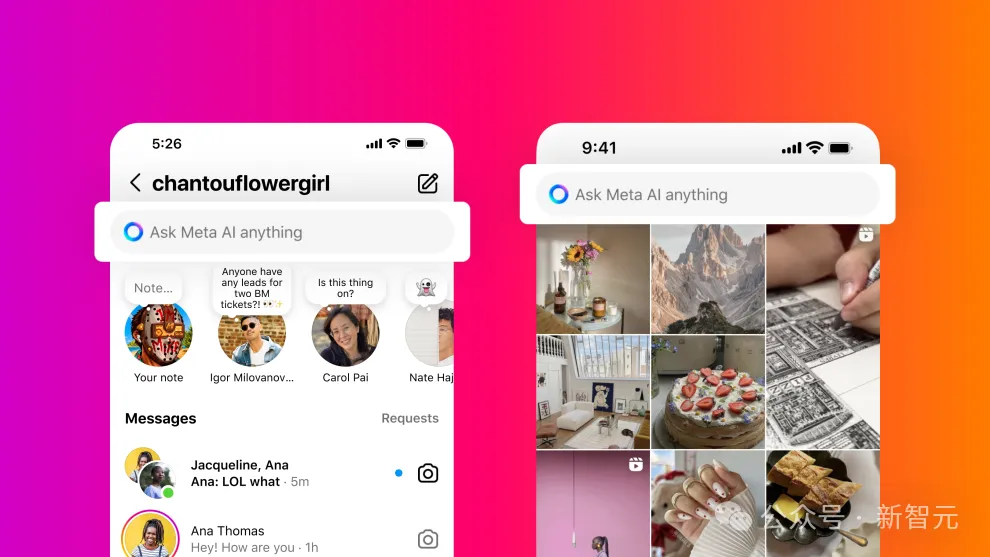

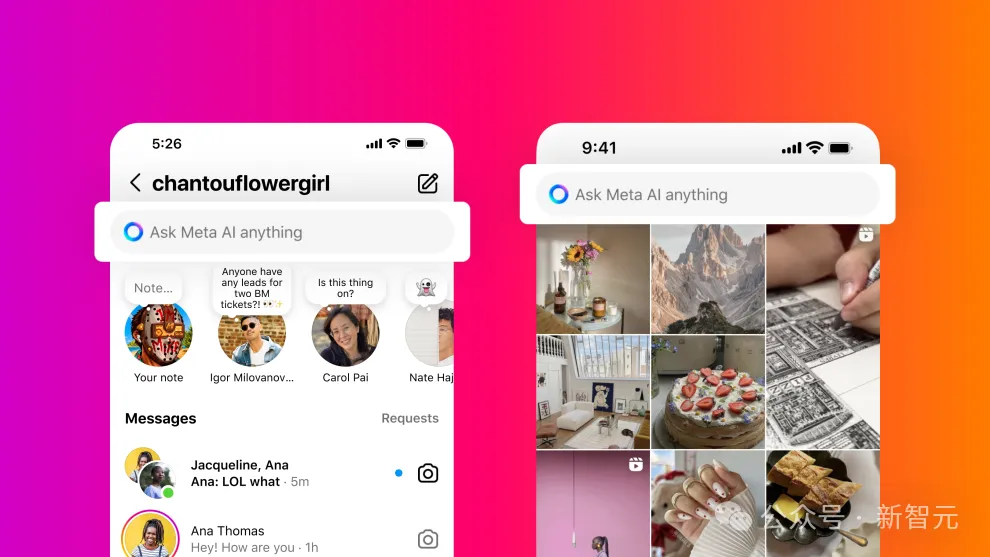

Llama 3加持,用户实测Meta AI还是弱爆了!小扎弯道超车的策略竟是「免费+不限量」?Llama 3开源后,聊天机器人Meta AI也宣布使用新模型作为基座,在Meta旗下的各种软件(Meta.ai、Instagram、Facebook、WhatsApp)中都可以进行免费体验。

Llama 3开源后,聊天机器人Meta AI也宣布使用新模型作为基座,在Meta旗下的各种软件(Meta.ai、Instagram、Facebook、WhatsApp)中都可以进行免费体验。

“预测下一个token”被认为是大模型的基本范式,一次预测多个tokens又会怎样?

抛弃传统方法,只采用Transformer来解码真实场景!

LLM界的「真·Open AI」,又来整顿AI圈了!

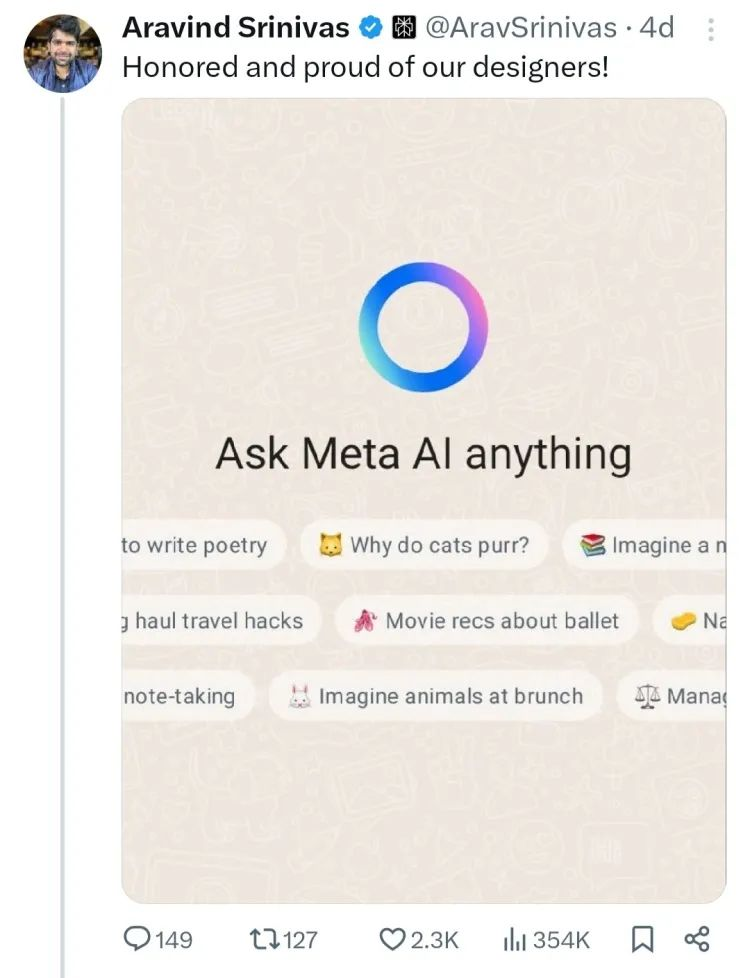

上周扎克伯格把Meta AI 聊天机器人向公众开放了

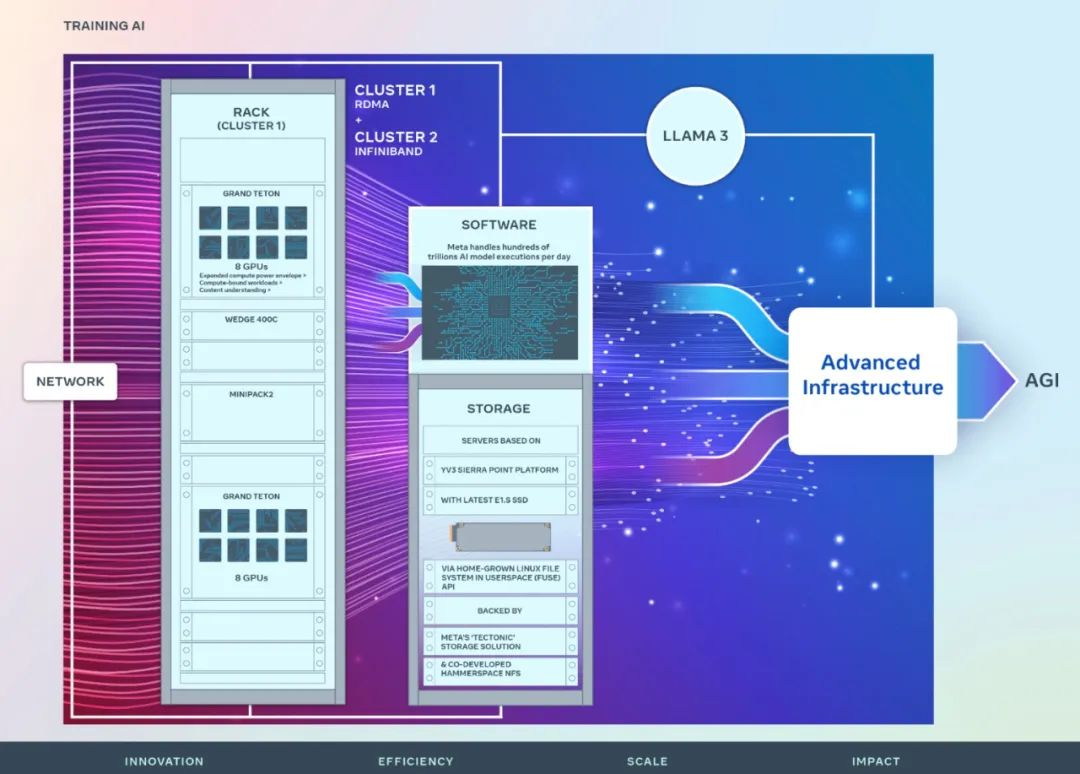

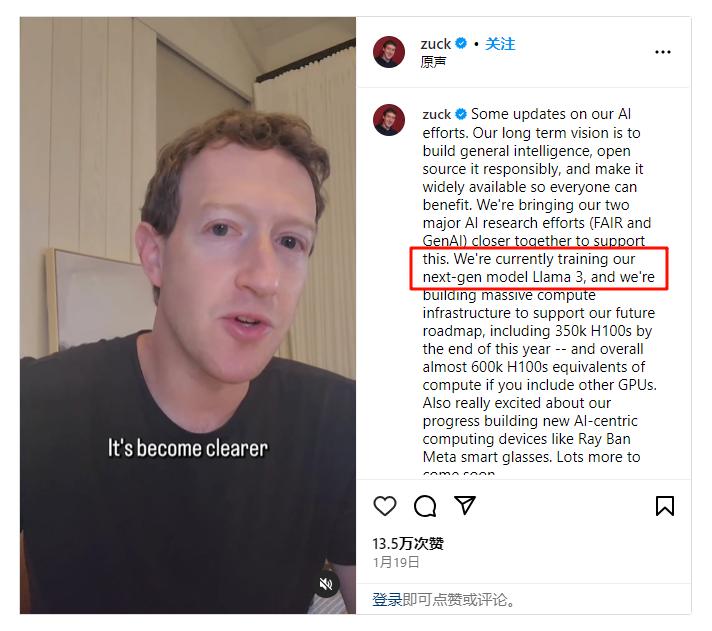

Meta 正在不遗余力地想要在生成式 AI 领域赶上竞争对手,目标是投入数十亿美元用于 AI 研究。这些巨资一部分用于招募 AI 研究员。但更大的一部分用于开发硬件,特别是用于运行和训练 Meta AI 模型的芯片

这款产品会将现有的两个空间计算的产品线(Quest 3 和雷朋 Meta 智能眼镜)整合起来,形成AI+AR眼镜的新形态产品。

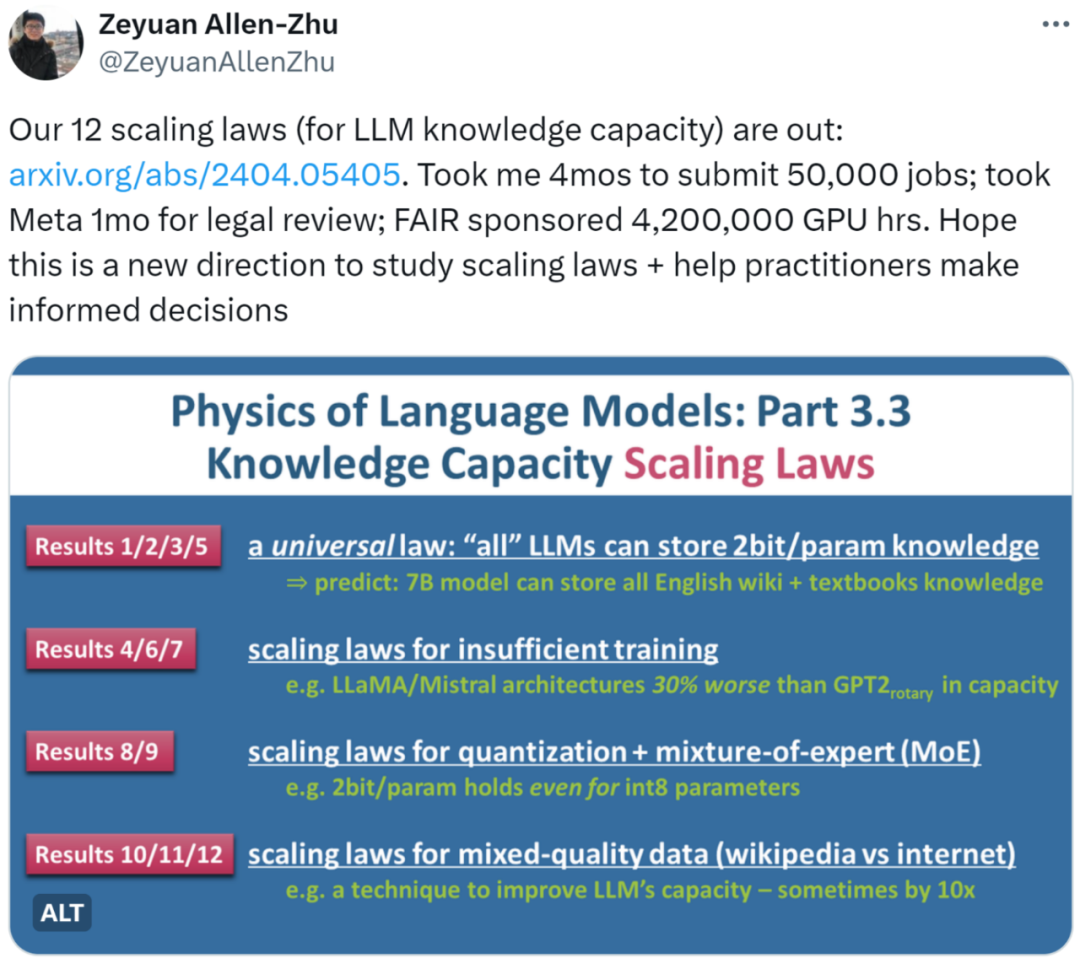

近日,朱泽园 (Meta AI) 和李远志 (MBZUAI) 的最新研究《语言模型物理学 Part 3.3:知识的 Scaling Laws》用海量实验(50,000 条任务,总计 4,200,000 GPU 小时)总结了 12 条定律,为 LLM 在不同条件下的知识容量提供了较为精确的计量方法。

刚刚,Meta 宣布推出两个 24k GPU 集群(共 49152 个 H100),标志着 Meta 为人工智能的未来做出了一笔重大的投资。

如果说 OpenAI 已经占据了今天闭源大模型生态的一极,那 Meta 无疑是代表开源大模型的另一极。